EAGLE实验室3篇论文被人工智能领域顶级会议AAAI2025录用

国际先进人工智能协会(Association for the Advancement of Artificial Intelligence, AAAI)是人工智能领域的主要国际学术组织之一。该协会主办的AAAI年会(AAAI Conference on Artificial Intelligence)是国际顶级人工智能学术会议之一。今年,AAAI共收到投稿12,957篇,最终录用3,032篇,录取率为23.4%。Eagle实验室博士生方辉的论文《Large Language Models Enhanced Personalized Graph Neural Architecture Search in Federated Learning》、博士生郭家龙的论文《MetaNeRV: Meta Neural Representations for Videos with Spatial-Temporal Guidance》以及硕士生沈宇帆的论文《ProcTag: Process Tagging for Assessing the Efficacy of Document Instruction Data》被AAAI2025录用。

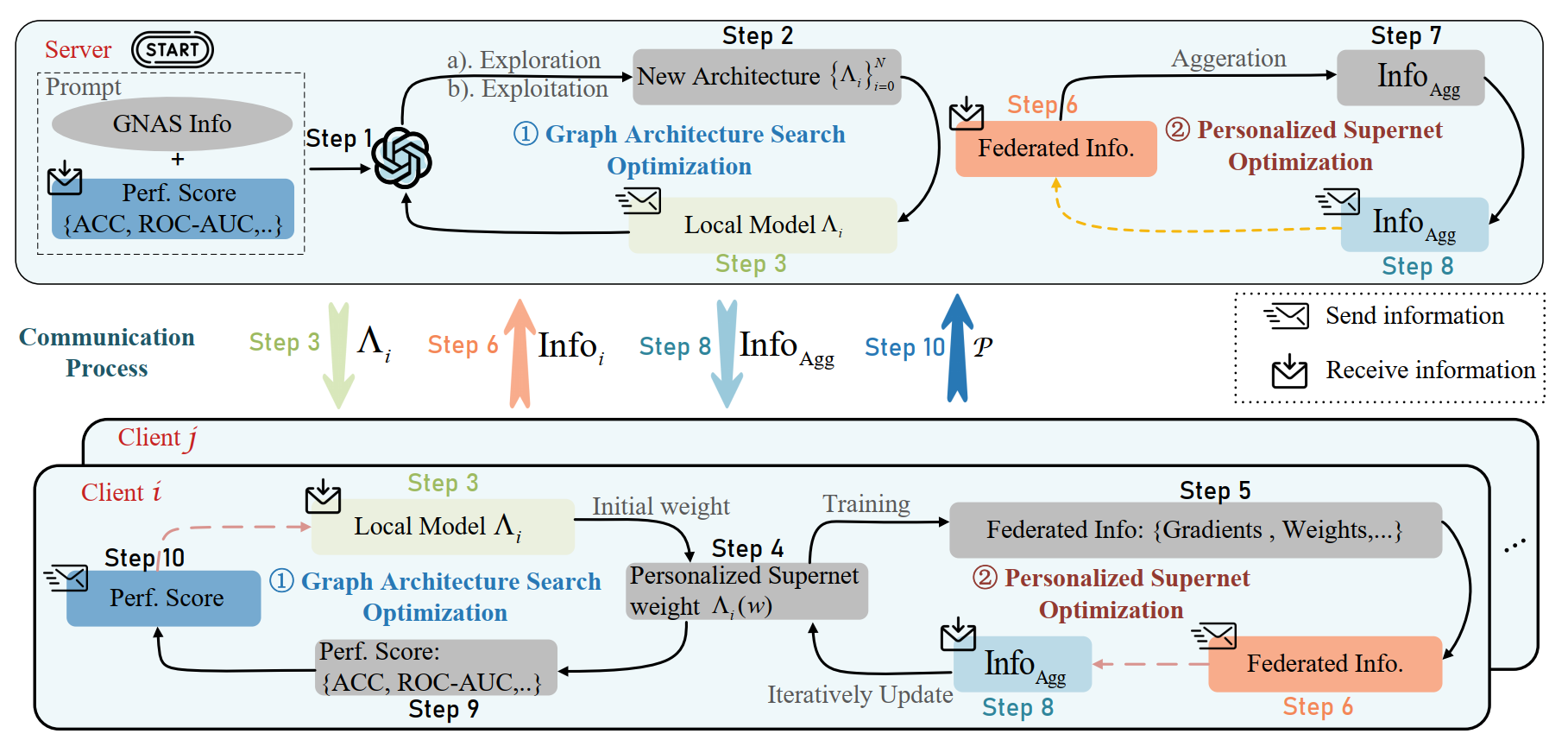

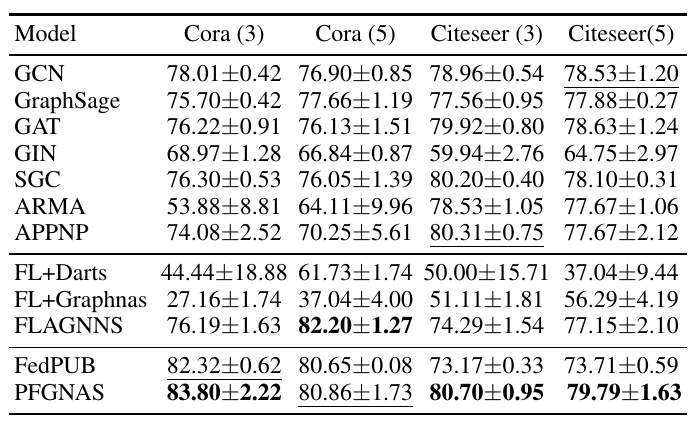

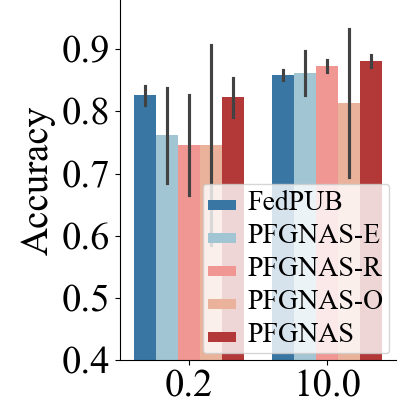

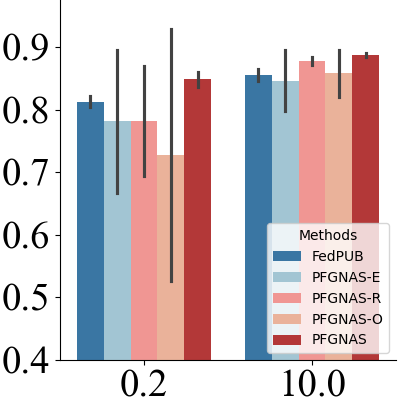

图上的个性化联邦学习(PFL)是一个新兴领域,专注于跨多个客户端的架构协作开发,每个客户端都具有不同的图数据分布,同时遵守严格的隐私标准。这个领域通常需要大量的专家介入模型设计,这是一个显著的限制。近期的相关工作旨在结合大语言模型(llm)的推理和自我反思能力自动搜索图神经网络架构。然而,这存在着两项技术挑战。首先,尽管llm在自然语言处理中是有效的,但它们满足图神经结构搜索(GNAS)复杂需求的能力仍在探索中。其次,虽然llm可以指导架构搜索过程,但它们不能直接解决由于异构数据分布而导致的客户端漂移问题。为了解决这些挑战,我们引入了一种新的方法-个性化联邦图神经系统架构搜索(PFGNAS)。

该方法采用特定于任务的提示来连续识别和集成最佳图神经网络架构。为了抵消客户端漂移,PFGNAS利用超级网络的权重共享策略,在确保客户端特定个性化的同时优化本地架构。

广泛的评估表明,PFGNAS显著优于传统的PFL方法,突出了将llm集成到个性化联邦学习环境中的优势。

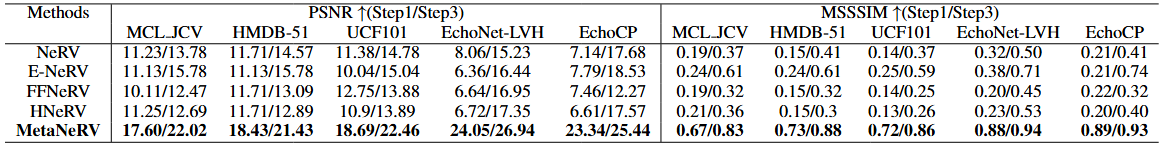

视频神经表征(NeRV)已成为一种颇具前景的视频分析隐式神经表征(INR)方法,该方法将视频表示成以帧索引作为输入的神经网络。

然而,基于NeRV的方法在处理大量不同视频时非常耗时,因为每个视频都需要从头开始训练一个单独的NeRV模型。此外,基于NeRV的方法在空间上需要从低维时间戳输入生成高维信号(即整幅图像),而视频通常由时间上相邻帧之间变化较小的数十帧组成。

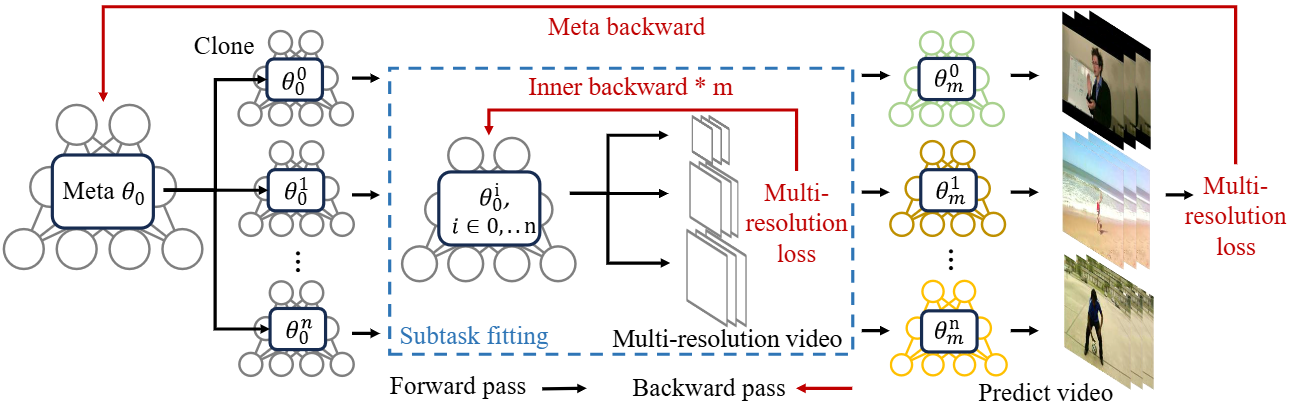

为了提高视频表征的效率,我们提出了面向视频的元神经表征,命名为MetaNeRV,这是一种针对未见视频实现快速NeRV表征的新型框架。

MetaNeRV利用元学习框架来学习最佳参数初始化,这为适应新视频提供了一个良好的起点。

为了应对视频模态独特的空间和时间特性,我们进一步引入了时空引导来增强MetaNeRV的表征能力。具体而言,具有多分辨率损失的空间引导旨在捕捉来自不同分辨率阶段的信息,而具有有效渐进学习策略的时间引导则可以在元学习过程中逐步优化拟合帧的数量。在多个数据集上进行的广泛实验证明了MetaNeRV在视频表征和视频压缩方面的优越性。

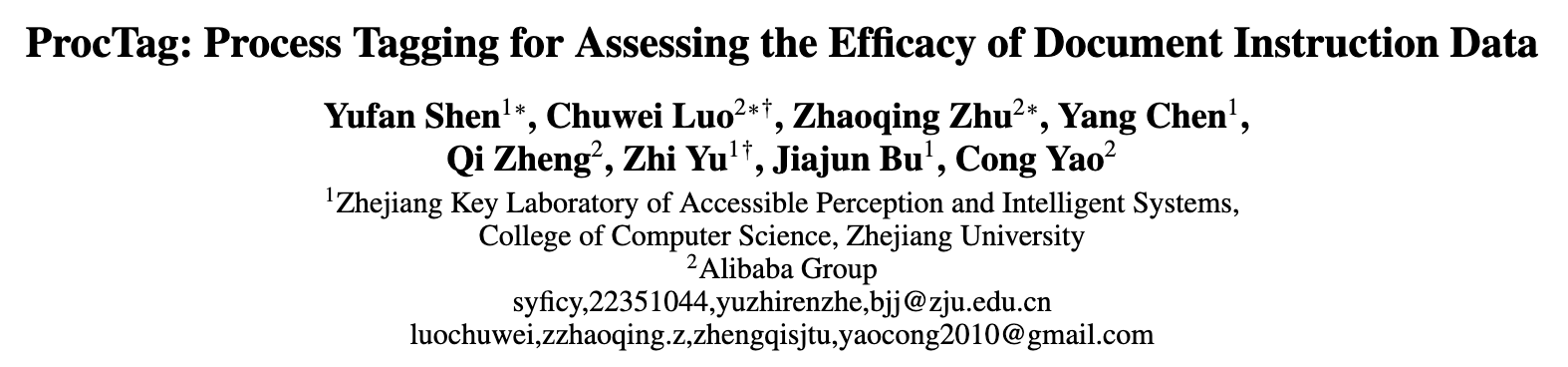

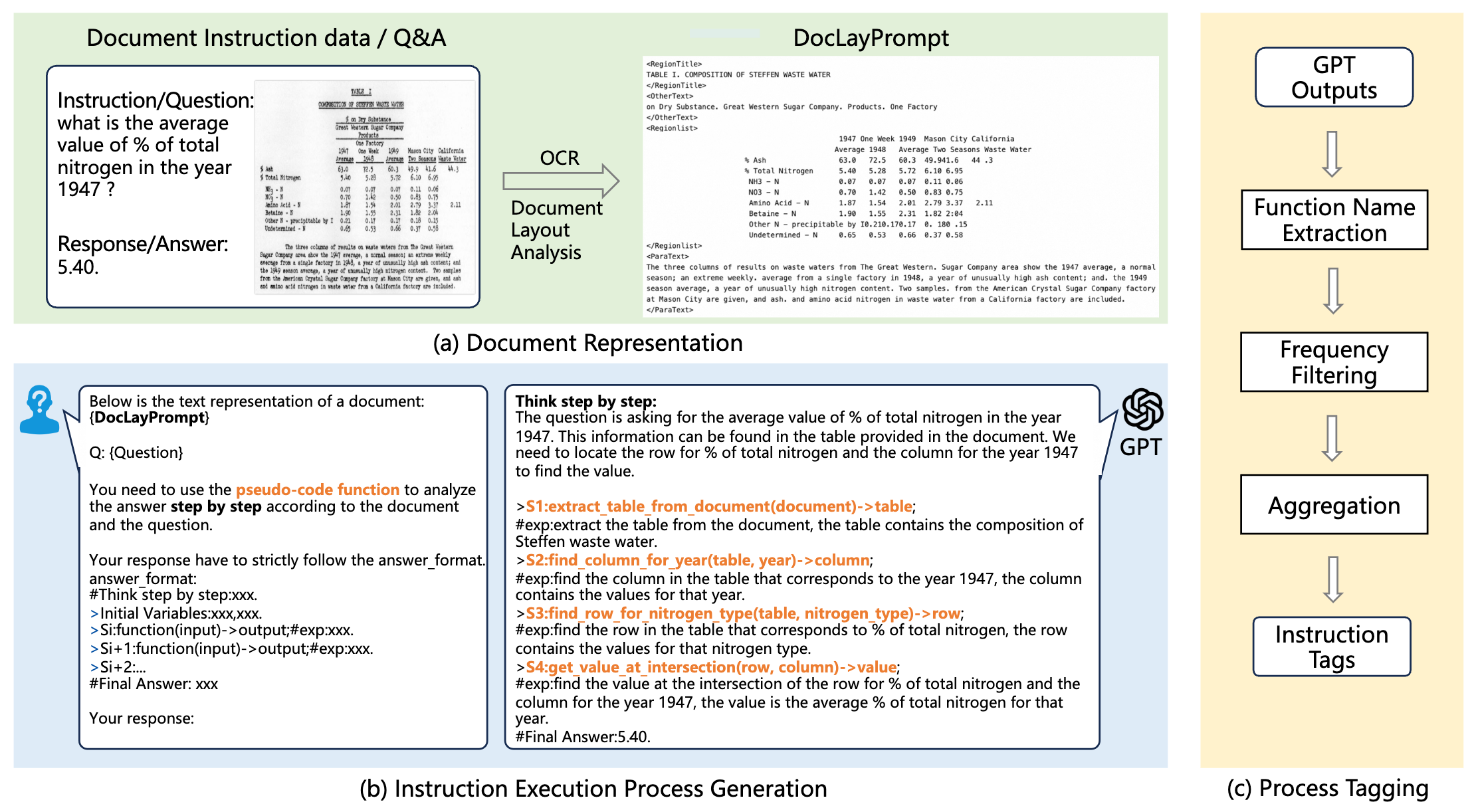

近年来,大语言模型(LLMs)和多模态大模型(MLLMs)在文档视觉问答(VQA)任务中展现了令人瞩目的成果,尤其是在文档指令数据集微调训练后,性能得以进一步提升。但现有的指令数据评估方法往往局限于文本内容或指令意图,无法全面衡量文档视觉问答数据的质量,制约了该任务的进一步优化。

为了解决这一问题,本文提出了一种新的多模态文档理解数据评估和筛选方法——ProcTag。与传统方法不同,ProcTag 通过伪代码建模指令执行过程,将伪代码作为标签,并根据多样性和复杂性来评估和筛选数据,从而提高数据利用效率和模型迭代效率。此外,本文还提出了DocLayPrompt,一种布局感知的结构化文档表示策略,用于更有效地文本化表示文档图片内容。实验表明,使用 ProcTag 对现有文档指令数据集进行评估采样,显著优于传统采样方法。在合成的文档数据集中,基于 ProcTag 的采样方法仅需保留 30.5% 的指令微调数据,即可达到全量数据微调的性能。

相关代码已在Github仓库开源,仓库地址为:

https://github.com/AlibabaResearch/AdvancedLiterateMachinery/tree/main/DocumentUnderstanding/ProcTag