EAGLE-Lab 两篇论文被人工智能领域顶级会议NeurIPS 2024录用

EAGLE-Lab博士生刘美含的论文《Revisiting,Benchmarking and Understanding Unsupervised Graph Domain Adaptation》和硕士生王中昊的论文《NoisyGL: A Comprehensive Benchmark for Graph Neural Networks under Label Noise》被NeurIPS 2024录用全文。

Neural Information Processing Systems (NeurIPS)是人工智能领域的顶级会议之一,是中国计算机学会(CCF)推荐的A类国际学术会议。

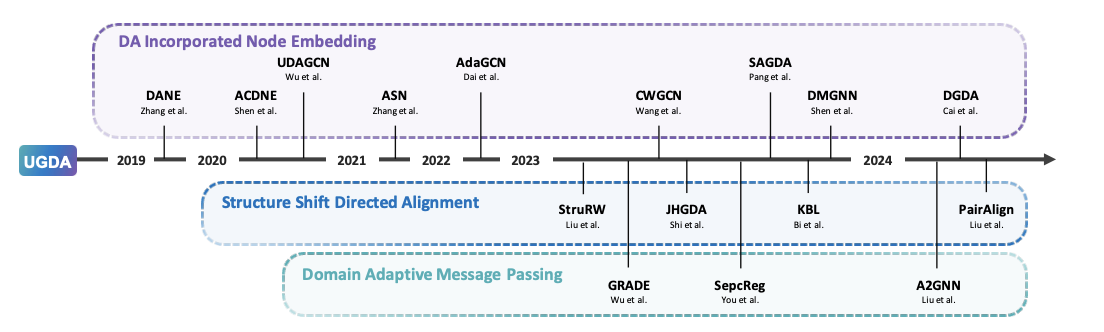

在过去的十年中,图神经网络(Graph Neural Networks, GNNs)取得了显著进展。然而,现实世界中图数据中的分布偏移和标签稀缺性阻碍了现有GNN模型适应新领域的能力。为了解决这一挑战,无监督图域适应(Unsupervised Graph Domain Adaptation, UGDA)将知识从有标签的源图转移到无标签的目标图,为图神经网络解锁了更广泛的应用。尽管目前已经发表了大量UGDA的研究,但是仍然存在以下局限性:(1)对域分布差异的评估不充分。(2)缺乏标准、公平和全面的比较。(3)对GNN的固有可迁移性能力的研究有限。

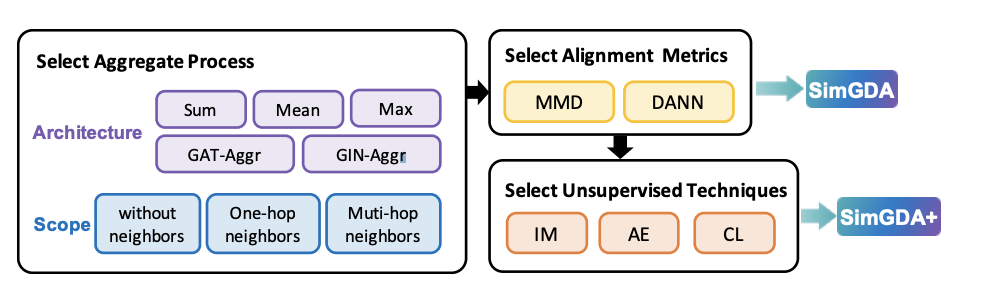

为了解决上述问题,我们重新回顾了现有的UGDA算法,并提出了统一的基准库GDAbench。GDAbench包括16种最先进的UGDA模型和5个涵盖节点属性、图结构和标签比例变化的多样的图数据集,可测试74个不同的任务。此外,我们还结合了7种GNN变体、2种域对齐和3种无监督图学习技术,来探索GNN可迁移性的极限。我们的工作首次提供了严格的实证分析,展示了各种聚合机制如何在域适应任务中影响对齐。

通过大量的实验分析,本文的结论如下:(1)当前UGDA模型在不同数据集和适应场景中的性能差异很大;(2)开发为图结构变化量身定制的策略至关重要,特别是当分布差异显著的时候;(3)GNN在UGDA中的可迁移性严重依赖于两个因素:聚合范围和聚合架构,这些因素受到标签偏移的严重程度和图异质性水平等因素的影响;(4)现有方法大大低估了GNN的固有可迁移性。

综上,本文的主要贡献有:(1)开发了第一个系统且标准的图域迁移算法库GDAbench。(2)系统的评估了现有算法,并实验分析了图域差异对GNN各个机制带来的影响。(3)基于实验分析的结论,提出了一种简单有效的方法来挖掘GNN域自适应能力的极限,该方法几乎在所有情况下超越了现有算法。

论文、代码和文档的链接如下:

Paper:https://arxiv.org/abs/2407.11052v1

Code: https://github.com/pygda-team/pygda

Docs: https://pygda.readthedocs.io/en/stable/

图神经网络(Graph Neural Networks, GNNs)在节点分类任务中通过消息传递机制展现了强大的表示力。然而,它们的性能往往依赖于高质量的节点标签。在现实世界中,由于不可靠的来源或对抗性攻击,高质量的节点标签难以获得。因此,标签噪声在现实世界的图数据中很常见。噪声标签会在训练过程中传播错误信息,从而对GNNs的泛化能力产生负面影响。为了解决这个问题,标签噪声下的图神经网络(GNNs under Label Noise, GLN)的研究最近受到了关注。

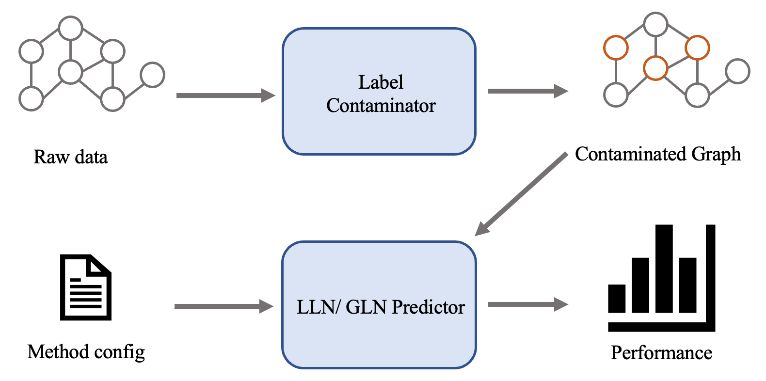

然而,由于数据集选择、数据分割和预处理技术的差异,目前针对该领域缺乏一个综合的基准,这阻碍了对GLN的深入理解和进一步发展。为填补这一空白,我们在本文中介绍了NoisyGL,这是第一个针对标签噪声下图神经网络的综合基准。NoisyGL使用统一的实验设置和接口,可以在具有不同性质的图数据上对不同方法的抗噪性能进行公平比较和多角度分析。此外,NoisyGL也是一个可扩展且易于使用的GLN框架,便于后续的研究者跟进。

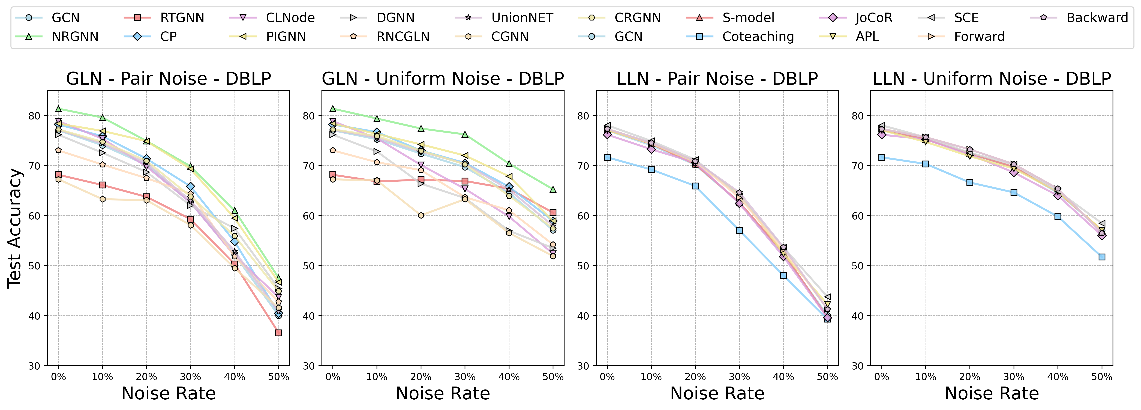

通过NoisyGL,我们进行了大量的实验,涵盖8个数据集和18种算法,并从实验结果中揭示了先前研究遗漏的几个重要见解:(1)多数LLN方法不能够显著提高GNNs的抗标签噪声能力。(2)现有的GLN方法具有抗噪能力,但他们有各自的适用范围。(3)非对称噪声比其它类型的噪声更容易造成过拟合,从而大幅度降低模型的泛化性能。(4)图标签噪声的负面影响会沿图拓扑结构扩散,这种扩散效应在稀疏图上尤为严重。(5)基于图结构增强的方法能够缓解图标签噪声的扩散效应。我们相信这些见解对未来的研究非常有益。

最后,我们为该领域未来的研究提供了一些思路:

(1)设计广泛适用的GLN方法。大多数现有的GLN方法无法在所有场景中确保一致的高性能,尤其在高度异质的图中。为了解决这个问题,我们可能需要探索几个关键问题:a)不同图数据集的共同属性是什么?b)如何利用这些共同属性增强GNNs对标签噪声的鲁棒性?我们的实验结果表明增强图结构可以减少标签噪声在不同密度图中的传播,进而引出第三个问题:c)如果难以识别共同属性,我们能否通过数据增强来统一这些特征?

(2)为各种图学习任务设计GLN方法。先前对GLN的研究主要集中在节点分类任务上。然而,图学习领域还包括其他重要应用,如链接预测、边属性预测和图分类等。这些应用也可能受到标签噪声的影响,需要进一步关注和探索。

(3)考虑图学习中的其他类型标签噪声。先前对GLN的研究假设图数据中存在两种标签噪声,即非对称噪声和均匀噪声上。然而,更为现实的假设是实例相关标签噪声,但目前尚未有相关的工作。此外,与其它领域的数据不同,图数据存在额外的图结构,图结构很有可能影响图数据的标注过程,因此图上的标签噪声模型很可能与图拓扑结构相关。

总的来说,这项工作的贡献在于:(1)提供了NoisyGL,第一个针对标签噪声下的图神经网络的综合基准库。(2)通过大量的实验,提出了一些重要的见解。(3)为标签噪声下的图学习领域的未来研究提供了可能的方向。

论文、代码的链接如下:

Paper:http://arxiv.org/abs/2406.04299

Code: https://github.com/eaglelab-zju/NoisyGL